انویدیا معماری جدید قدرتمند تراشه Rubin را راه اندازی کرد

Nvidia launches powerful new Rubin chip architecture

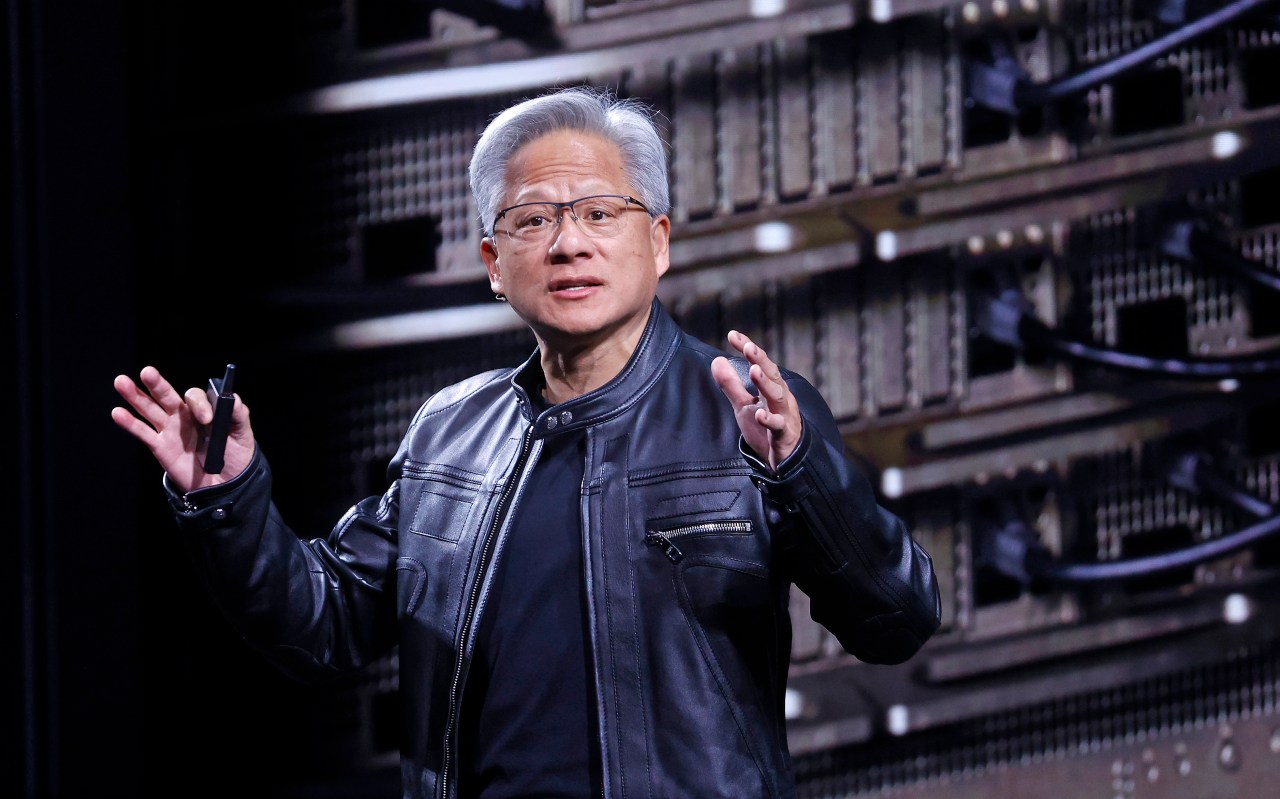

امروز در نمایشگاه Consumer Electronics، مدیر عامل انویدیا، جنسن هوانگ، معماری جدید محاسباتی Rubin این شرکت را رسماً معرفی کرد که از آن به عنوان آخرین هنر در سخت افزار هوش مصنوعی یاد کرد. معماری جدید در حال حاضر در حال تولید است و انتظار می رود در نیمه دوم سال افزایش بیشتری پیدا کند. Vera Rubin برای مقابله با این چالش اساسی طراحی شده است: میزان محاسبات لازم برای هوش مصنوعی در حال افزایش است. هوانگ به حضار گفت. "امروز می توانم به شما بگویم که Vera Rubin در حال تولید کامل است." معماری Rubin که برای اولین بار در سال 2024 معرفی شد، آخرین نتیجه چرخه توسعه سخت افزاری بی امان انویدیا است که انویدیا را به با ارزش ترین شرکت جهان تبدیل کرده است. معماری روبین جایگزین معماری بلکول خواهد شد که به نوبه خود جایگزین معماری هاپر و لاولیس شد. تراشههای Rubin در حال حاضر برای استفاده توسط تقریباً هر ارائهدهنده ابری بزرگ، از جمله مشارکتهای پرمخاطب انویدیا با Anthropic، OpenAI، و خدمات وب آمازون در نظر گرفته شدهاند. سیستمهای Rubin همچنین در ابررایانه شیر آبی HPE و ابررایانه آینده Doudna در آزمایشگاه ملی لارنس برکلی استفاده خواهند شد. معماری روبین که به نام ستاره شناس ورا فلورانس کوپر روبین نامگذاری شده است از شش تراشه مجزا تشکیل شده است که برای استفاده در کنسرت طراحی شده اند. پردازنده گرافیکی Rubin در مرکز قرار دارد، اما این معماری همچنین با پیشرفتهای جدید در سیستمهای Bluefield و NVLink به تنگناهای فزاینده در ذخیرهسازی و اتصال متقابل میپردازد. این معماری همچنین شامل یک CPU جدید Vera است که برای استدلال عاملی طراحی شده است. دیون هریس، مدیر ارشد راهحلهای زیرساخت هوش مصنوعی انویدیا، در توضیح مزایای ذخیرهسازی جدید، به تقاضای رو به رشد حافظه مرتبط با حافظه پنهان سیستمهای هوش مصنوعی مدرن اشاره کرد. هریس در تماسی با خبرنگاران با اشاره به سیستم حافظه ای که مدل های هوش مصنوعی برای فشرده سازی ورودی ها استفاده می کنند، به خبرنگاران گفت: «همانطور که شروع به فعال کردن انواع جدیدی از گردش های کاری، مانند هوش مصنوعی یا وظایف بلندمدت می کنید، استرس و الزامات زیادی را روی حافظه پنهان KV شما وارد می کند. بنابراین ما یک سطح جدید از فضای ذخیرهسازی را معرفی کردهایم که بهصورت خارجی به دستگاه محاسباتی متصل میشود، که به شما امکان میدهد استخر ذخیرهسازی خود را بسیار کارآمدتر افزایش دهید.» همانطور که انتظار می رفت، معماری جدید همچنین نشان دهنده پیشرفت قابل توجهی در سرعت و بهره وری قدرت است. طبق آزمایشهای انویدیا، معماری Rubin در کارهای آموزش مدل سه و نیم برابر سریعتر از معماری قبلی بلکول و در کارهای استنتاج پنج برابر سریعتر عمل میکند و به ۵۰ پتافلاپ میرسد. پلتفرم جدید همچنین هشت برابر محاسبات استنتاج در هر وات را پشتیبانی می کند. قابلیتهای جدید روبین در بحبوحه رقابت شدید برای ساخت زیرساختهای هوش مصنوعی به دست میآیند که هم آزمایشگاههای هوش مصنوعی و هم ارائهدهندگان ابری را برای یافتن تراشههای انویدیا و همچنین امکانات لازم برای تامین انرژی آنها به چالش میکشند. هوانگ در یک تماس درآمد در اکتبر 2025 تخمین زد که بین 3 تا 4 تریلیون دلار در پنج سال آینده برای زیرساخت های هوش مصنوعی هزینه خواهد شد. همه پوشش های TechCrunch از کنفرانس سالانه CES را در اینجا دنبال کنید.

- AI

- ai infrastructure

- ces 2026

- compute

- Hardware

- nvidia

- Rubin architecture

- TC